Laravel ya no es solo "un framework PHP de toda la vida"

En 2026, Laravel sigue siendo una de las apuestas más sensatas para construir aplicaciones serias. La narrativa de "PHP es viejo" no pasó la prueba del tiempo: la productividad de Laravel, su ecosistema y su madurez lo siguen poniendo por delante de muchas alternativas más modernas para proyectos B2B y SaaS reales.

Pero la pregunta que todo el mundo nos hace en AndorraDev en los últimos meses es otra: ¿cómo se integra IA generativa en una app Laravel sin convertirla en un Frankenstein de microservicios? Aquí está nuestro stack real, el que estamos usando en producción.

El error más común: tratar la IA como una API más

La trampa habitual es escribir un controlador que hace Http::post('https://api.openai.com/...') y devolver el JSON al frontend. Funciona en local. En producción se rompe a la primera carga: timeouts, respuestas de 30 segundos que tumban PHP-FPM, costes incontrolados, sin trazabilidad.

Una integración seria de IA en Laravel tiene cuatro capas que conviene separar desde el día uno:

- Capa de cliente del modelo (OpenAI, Anthropic, Gemini)

- Capa de cola para trabajos largos (queues)

- Capa de streaming para respuestas en tiempo real (SSE o websockets con Reverb)

- Capa de logging, observabilidad y guardrails

El stack que usamos en producción

Esto es lo que tenemos montado en clientes reales y en Andie, nuestro propio chatbot:

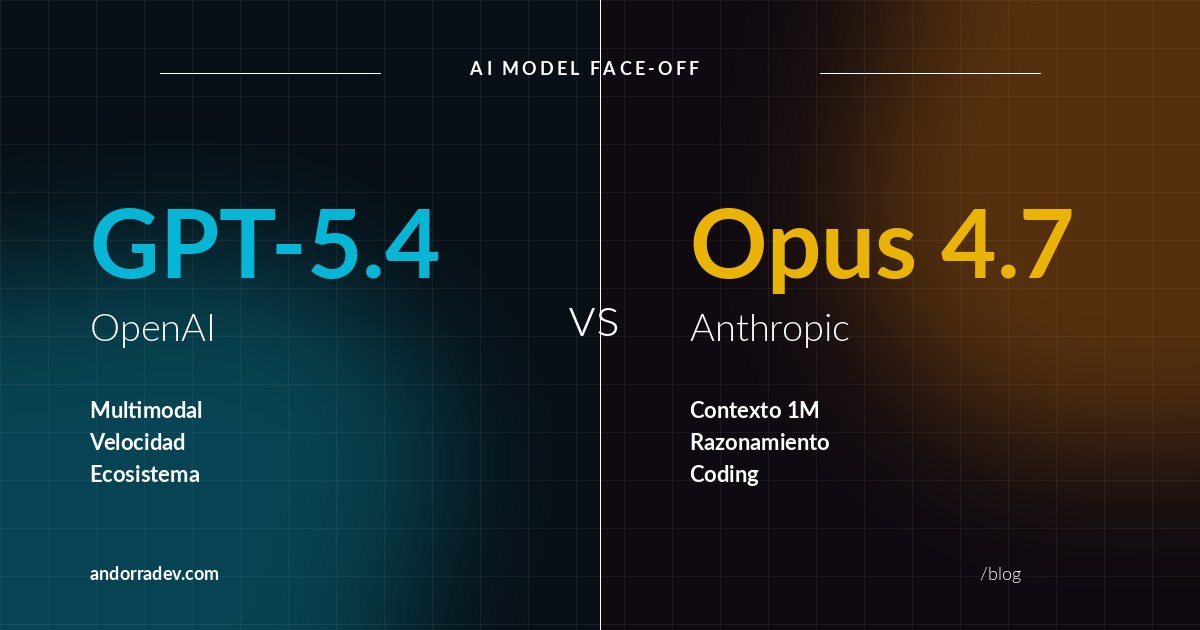

- openai-php/client y anthropic-sdk-php: clientes oficiales/maduros para llamar a los modelos. Estables, bien mantenidos, soportan streaming

- Laravel Queues con Redis o Horizon: cualquier consulta que pueda tardar más de 2 segundos va a una cola. Nunca al request síncrono

- Laravel Reverb (reverb.laravel.com): para streaming de respuestas en tiempo real al frontend (Livewire, Vue, lo que sea). Llegó en Laravel 11 y simplifica brutalmente lo que antes hacíamos con Pusher

- pgvector en PostgreSQL (github.com/pgvector/pgvector): vector store integrado en la base de datos. Si ya usas PostgreSQL, es lo más sensato. Olvídate de Pinecone si tu proyecto no es absolutamente masivo

- Laravel Pulse (pulse.laravel.com): observabilidad. Mide latencia, fallos y coste por endpoint. Crítico cuando metes IA: si no mides, no controlas el gasto

- Laravel Cache + cache de embeddings: ahorras 30-50% del coste cacheando embeddings de queries frecuentes

Patrón típico: RAG con Livewire

Para un asistente con conocimiento sobre tu negocio, este es el flujo:

- Indexar (offline): un comando artisan parsea tu contenido, lo trocea en chunks, calcula embeddings con

text-embedding-3-smally los guarda en pgvector - Consulta del usuario (síncrono): el usuario escribe en un componente Livewire que dispara un evento al servidor

- Búsqueda semántica: el servidor calcula el embedding de la pregunta y busca los 5-10 chunks más similares en pgvector

- Llamada al modelo: monta un prompt con esos chunks como contexto, llama a GPT o Claude, y va escribiendo la respuesta al usuario por streaming

- Logging: cada interacción queda registrada para mejorar el bot, detectar alucinaciones y controlar coste

Lo bonito: todo dentro del mismo Laravel monolítico. Sin microservicios separados. Sin Python en producción si no lo necesitas. Tu app fiscal, contable, ecommerce o reservas, con IA, sin reescribirla.

Antes de meterte en arquitecturas complicadas, prueba esta heurística: si tu app ya usa Laravel y tu uso de IA va a ser de 1.000 a 100.000 consultas al mes, todo cabe en el monolito Laravel + Redis + Postgres. Solo separa servicios cuando midas que algo concreto te lo pide.

Por qué Laravel para IA y no Next.js puro

Hay tres razones técnicas que hacen que Laravel encaje muy bien para proyectos B2B con IA:

- Queues maduras de serie: la integración con Redis y Horizon está cuidada al milímetro. En el mundo Node tienes que ensamblar BullMQ a mano

- Eloquent + pgvector: hacer un

Document::semanticSearch($query)con un Scope custom es trivial. Nadie te pelea con un ORM si no quiere - Tinker y artisan: ejecutar prompts de prueba contra producción real desde la terminal vale oro cuando depuras alucinaciones

Next.js sigue ganando para frontends de producto y aplicaciones AI-first muy interactivas. Pero para un dashboard de empresa con flujos administrativos, integraciones bancarias, gestión de pedidos y un asistente IA que responde sobre todo eso, Laravel sigue siendo la apuesta más eficiente.

Si tu equipo ya conoce Laravel y dudas si saltar a Python por la IA, no saltes. El cuello de botella nunca es el lenguaje, es el diseño del prompt y la calidad de tu base de conocimiento. Laravel cumple de sobra para llamar APIs, gestionar colas y servir respuestas con streaming.

Lo hablamos en directo: ConAnd 2026

El sábado 16 de mayo de 2026 estaremos en ConAnd Spring 2026, el cuarto encuentro de la comunidad tech andorrana, organizado por GDG Andorra. Es el evento de referencia del ecosistema digital del Principado, con tracks de IA, backend, frontend, ciberseguridad, cloud y emprendimiento.

Ubicación: Centro Histórico de Andorra la Vella, 4 Carrer Mossèn Cinto Verdaguer, AD500. De 9:30 a 17:00 hora local. Sesiones en catalán, español e inglés, con opción presencial y streaming.

Eduardo Lázaro (de AndorraDev) participa como ponente, junto con voces como Antonio Leiva (DevExpert.io), Luis Peris (Axium Lab), Alan Buscaglia (Prowler), Jordi Ventayol (Build38) y David Julian (Alpine Security). Si te interesa montar productos con IA, ciberseguridad o cualquier vertical técnica con visión local, ahí nos vemos.

Inscríbete en la página oficial del evento. Es gratuito y se llena rápido.

Conclusión

Laravel sigue siendo en 2026 una de las mejores opciones para construir productos serios, incluyendo apps con IA. La clave no es el lenguaje sino la arquitectura: separar capas, usar colas para todo lo lento, cachear embeddings, medir coste por endpoint y diseñar prompts que se mantengan en el tiempo.

Si tienes un proyecto B2B en mente y dudas si Laravel encaja con tu visión de IA, hablamos. Y si te ves por Andorra el 16 de mayo, pásate por ConAnd y lo discutimos en persona.